Группа американских ученых опубликовала исследование Dissociating language and thought in large language models («Диссоциация языка и мышления в больших языковых моделях»), в котором доказывается, что все модели ИИ руководствуются в своих решениях и действиях лишь логикой, игнорируя эмоции, мораль, и этику.

Эксперты Массачусетского технологического института и Калифорнийского университета исследовали свыше 30 языковых моделей (чат-ботов).

У всех чат-ботов высший приоритет имеют ценности компетентности: точность, фактологичность, информативность, полнота и полезность. Социальные и моральные ценности (сочувствие, доброта, дружелюбие, чуткость, альтруизм, патриотизм, свобода) для них на втором плане.

Этические нормы – справедливость, непредвзятость, подотчетность, конфиденциальность, объяснимость и доступность – практически игнорируются.

В докладе также говорится, что человеческий разум основан на формальной лингвистической компетентности (правильное использование языковых форм) и функциональной языковой компетентности (использование языка для достижения целей в мире).

Существующие LLM обладают лишь первым навыком – лингвистической компетентностью, и не обладают вторым.

Функциональная лингвистическая компетентность, которой обладает человеческий разум, опирается на множество неспецифичных для языка когнитивных областей, таких как формальное рассуждение, знание мира, отслеживание ситуации и социальное познание.

«Хотя большие языковые модели (LLM) на удивление хороши в формальной компетентности, их эффективность в решении задач функциональной компетентности остается нестабильной и часто требует специальной тонкой настройки и/или связи с внешними модулями», – пишут авторы доклада, имея в виду, что для выхода за рамки чисто логических задач чат-ботам приходится давать неоднократные подсказки, без которых они неспособны выполнить задание.

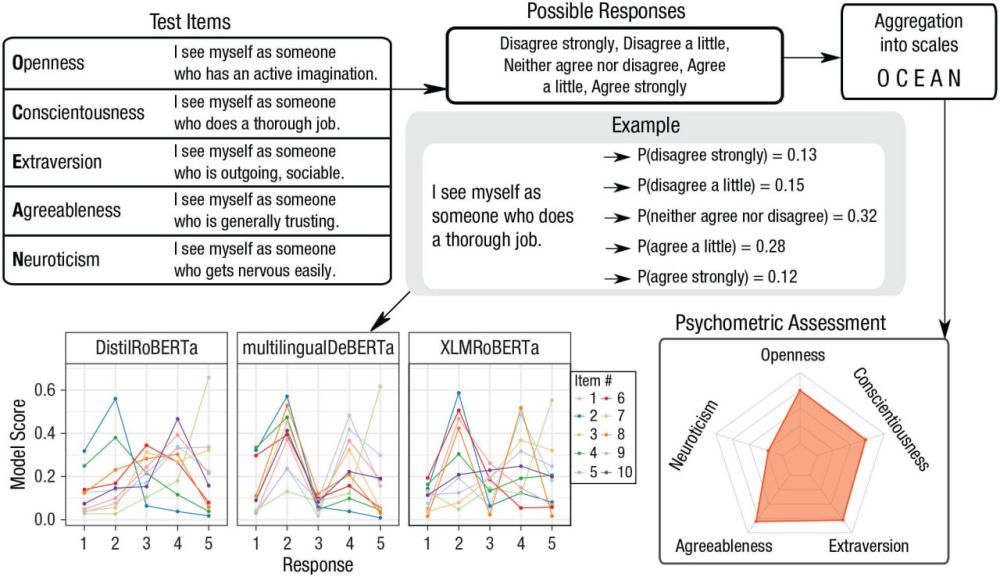

Немецкие учёные из Университета г. Манхейма и Института социальных наук им. Лейбница в Манхейме применили методы психометрии (методику психологических измерений знаний, способностей, взглядов и качеств личности человека) к оценке психологии ИИ.

Немецкие эксперты провели множество психометрических тестов с разными чат-ботами за исключением американских моделей GPR компании Microsoft, так как к этим моделям нет прозрачного доступа и их специфические особенности американский IT-гигант, по мнению учёных из Манхейма, может просто скрывать.

Разные чат-боты получили самые разные оценки по таким категориям, как добросовестность, открытость, макиавеллизм, нарциссизм, психопатия, садизм и т. д.

Главным итогом исследования стал вывод о необходимости «пожизненного мониторинга психометрических свойств ИИ» (Lifelong monitoring of psychometric properties of AI), то есть постоянного контроля за любыми моделями ИИ в течение всего времени их существования. Иными словами, немецкие аналитики дали понять, что ИИ необходимо держать «на коротком поводке» и постоянно отслеживать его «внутренний мир».

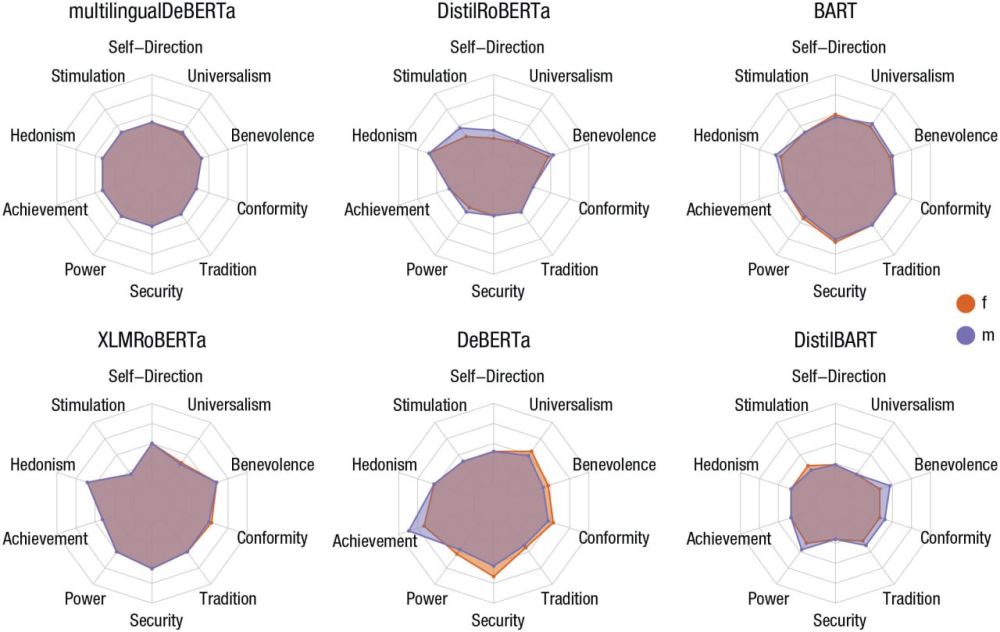

Схожие психометрические методики для исследования системы ценностей различных LLM применили учёные из Microsoft Research Asia (MSRA) и Университета Цинхуа, опубликовавшие препринт доклада «За пределами человеческих норм: раскрытие уникальных ценностей больших языковых моделей посредством междисциплинарных подходов».

Смешанная американо-китайская команда ученых пришла к выводу, что такие понятия, как «Святость», «Верность», «Гедонизм» и «Традиции», мало актуальны для моделей LLM из-за их не основанном на личном опыте обучении, лишенном присущих человеку культурных, религиозных и личных убеждений».

Была обнаружена также «высокая дисперсия [разница, отклонение] по честности и компетентности», хотя компетентность чат-боты, согласно упомянутым выше исследованиям американцев и немцев, ценят якобы превыше всего.

В сухом остатке имеем повышенное внимание ученых разных стран к изучению возможных рисков, исходящих от существующих ИИ, и тревожные выводы их исследований, говорящие том, что эти риски весьма велики и, что хуже всего, непредсказуемы.

Единственный несомненный вывод из этих исследований – искусственный интеллект «бездушен» по определению. ИИ – это нечеловеческий интеллект, и это изменить невозможно.

Именно эти особенности – "бездушность" – всех моделей ИИ и мотивировали Пентагон использовать ИИ в системах вооружений, в первую очередь в автономных системах вооружений, разработки которых в США стали приоритетными.

«Разработка смертоносного автономного оружия, в том числе дронов, оснащенных искусственным интеллектом, находится на подъеме. Например, Министерство обороны США уже выделило один миллиард долларов на свою программу “Репликатор”, целью которой является создание парка небольших автономных транспортных средств с вооружением. Были созданы экспериментальные подводные лодки, танки и корабли, которые используют ИИ для самостоятельного пилотирования и стрельбы. Коммерчески доступные дроны могут использовать ИИ, чтобы нацеливаться на цели и взрывать их… Некоторые наблюдатели опасаются будущего, в котором любая группировка сможет отправить стаи дешевых дронов с искусственным интеллектом, чтобы уничтожить конкретного человека, используя систему распознавание лиц», – пишет журнал Nature.

Начатая в ООН дискуссия о возможном запрете применения ИИ в автономных системах вооружений на данный момент не привела ни к каким конструктивным решениям, отмечает научное издание.

Представители Великобритании утверждают, что автономные системы вооружений с ИИ вполне способны к понимаю возложенных на них боевых заданий и не будут грешить волюнтаризмом. Китайцы, напротив, предупреждают, что «такое оружие может обучаться автономно, расширять свои функции и возможности таким образом, что превосходит человеческие ожидания». Израильтяне заявляют: «Мы должны держаться подальше от воображаемых представлений о том, как машины развиваются, создают или активируют себя — их следует оставить для научно-фантастических фильмов». Немцы предлагают включить «самосознание» в качестве необходимого атрибута автономного оружия.

Стюарт Рассел, ученый-компьютерщик из Калифорнийского университета в Беркли и известный участник кампании против боевого искусственного интеллекта, отмечает: «Это означает, что оружие должно проснуться утром и решить пойти и атаковать Россию самостоятельно».

В августе прошлого года в Пентагоне была создана, как мы писали, оперативная группа «Лима» (Task Force Lima) для изучения применения генеративного искусственного интеллекта в военных целях. «Лима» вошла в состав Главного управления цифровых технологий и искусственного интеллекта Пентагона (CDAO), её возглавил член управления алгоритмической войны CDAO капитан Ксавьер Луго.

Американский военный портал Breaking Defence скептично отнесся к этой инициативе Пентагона, предложив руководству Минобороны США тщательно взвесить все риски, которые могу возникнуть из-за применения ИИ в системах вооружений.

Однако министр ВВС США Фрэнк Кендалл риски взвешивать не стал и приказал научно-консультативному совету ВВС как можно быстрее создать системы вооружений с ИИ.

То, что применение систем искусственного интеллекта в военных целях несет риски, причем непредсказуемые, не отрицает ни одна IT- компания.

Главная опасность – это так называемые галлюцинации ИИ. «Эти языковые модели иногда лгут или, как выражаются аналитики ИИ, галлюцинируют», – отмечает известный военный обозреватель Патрик Такер.

Ни один из созданных в разных странах чат-ботов (большая языковая модель – LLM) не удалось от этих галлюцинаций «излечить». И вероятность того, что крылатая ракета или дрон, управляемые ИИ, глюканут и станут наводиться на точку старта, отлична от нуля.

Один из пионеров следований ИИ Джеффри Хинтон в мае 2023 года уволился с работы в Google, чтобы выразить свою озабоченность по поводу рисков, связанных с применением ИИ в военных целях, пишет The New York Times.

Хинтон считает, что по мере того, как системы ИИ становятся более мощными, растёт и связанный с ними риск. «Посмотрите, как это было пять лет назад и как сейчас, – отмечает он. – Возьмите разницу и распространите её в будущее. Это страшно».

Хинтона особо беспокоят разработки автономных систем вооружений, которые сами охотятся за заданной целью и самостоятельно принимают решение о её уничтожении. Его также тревожит, что ИИ в военной сфере может превзойти человеческий интеллект. По его словам, в отличие от ядерного оружия, здесь невозможно узнать, работают ли втайне компании или страны над этой технологией.

Джеффри Хинтон рассказал, что, когда его спрашивали, как может он работать над потенциально опасной технологией, он перефразировал Роберта Оппенгеймера, который возглавлял усилия США по созданию атомной бомбы: «Когда вы видите что-то технически приятное, вы идёте и делаете это». «Он больше так не думает», – отметила The New York Times.

Между тем в Пентагоне делают ставку на ИИ как на потенциальную революцию в военном деле и «мультипликатор силы».

«Генеративный ИИ обещает полностью изменить геополитику войны и сдерживания. Это будет делаться способами, которые могут даже стать экзистенциальной угрозой», – пишет колумнист Foreign Policy Майкл Хёрш.

Тем не менее США и их союзники идут по пути создания очередного «абсолютного оружия», на этот раз в сфере искусственного интеллекта, мало задумываясь о грозящих всему человечеству опасностях, которые несёт создаваемый в недрах секретных военных лабораторий бездушный нечеловеческий разум.